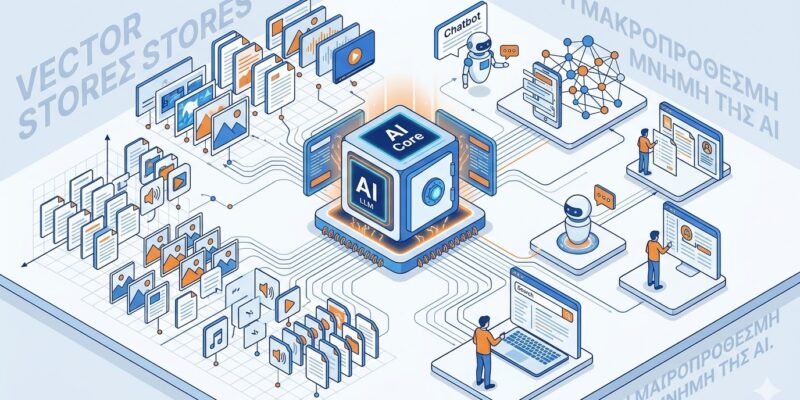

Vector Stores

Η «Μακροπρόθεσμη Μνήμη» της Τεχνητής Νοημοσύνης

Στην εποχή των Μεγάλων Γλωσσικών Μοντέλων (LLMs), ακούμε συχνά για το πόσο έξυπνο είναι το AI. Όμως, το AI έχει ένα βασικό πρόβλημα: ξεχνάει. Ή μάλλον, γνωρίζει μόνο όσα περιλαμβάνονται στην εκπαίδευσή του ή όσα χωράνε στο παράθυρο της συνομιλίας σας.

Εδώ έρχονται τα Vector Stores (Διανυσματικές Βάσεις Δεδομένων), η τεχνολογία που επιτρέπει στο AI να αποκτά πρόσβαση σε τεράστιους όγκους πληροφοριών σε κλάσματα δευτερολέπτου.

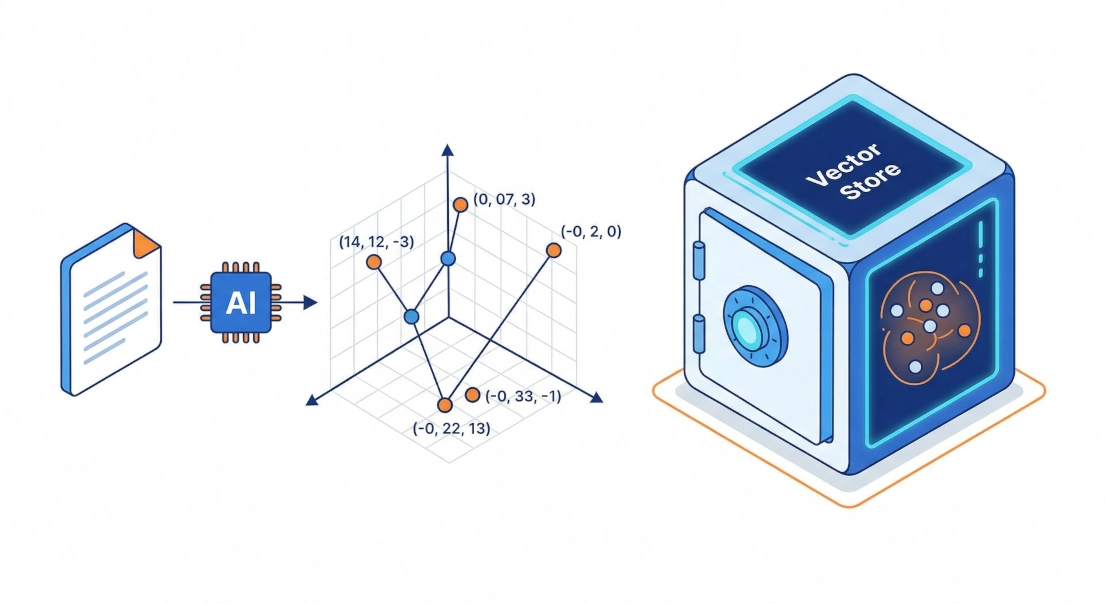

Στην αριστερή πλευρά βλέπουμε έγγραφα (κείμενο). Ένα βέλος δείχνει προς ένα κεντρικό “μηχανισμό” (το Embedding Model), ο οποίος μετατρέπει το κείμενο σε μια σειρά αριθμών (διανύσματα). Στη δεξιά πλευρά, αυτοί οι αριθμοί αποθηκεύονται σε μια βάση δεδομένων που μοιάζει με ψηφιακό κύβο

Τι είναι το Vector Store

Σε αντίθεση με τις παραδοσιακές βάσεις δεδομένων (SQL) που αποθηκεύουν πληροφορίες σε γραμμές και στήλες, ένα Vector Store αποθηκεύει δεδομένα ως μαθηματικά διανύσματα (vectors) σε έναν πολυδιάστατο χώρο.

Όταν εισάγουμε ένα κείμενο, μια εικόνα ή έναν ήχο, αυτό μετατρέπεται μέσω ενός μοντέλου Embedding σε μια σειρά αριθμών. Αυτοί οι αριθμοί αντιπροσωπεύουν το νόημα του περιεχομένου και όχι απλά τις λέξεις.

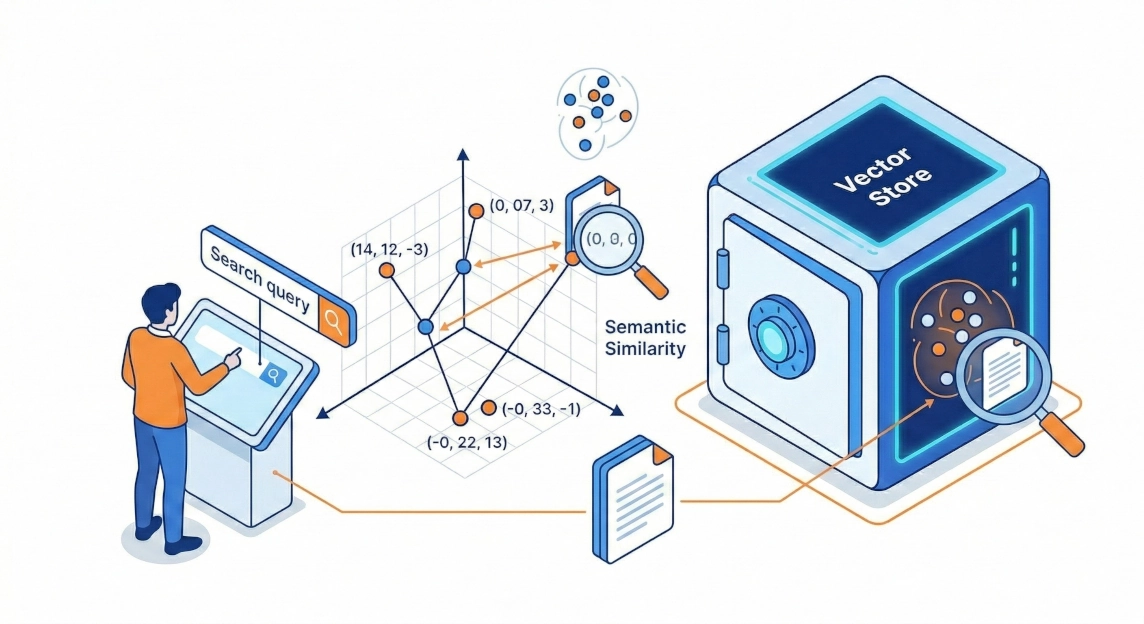

Πώς λειτουργεί η «Σημασιολογική Αναζήτηση»

Φανταστείτε ότι ψάχνετε σε μια βάση δεδομένων τη λέξη «αυτοκίνητο».

Παραδοσιακή βάση: Θα σας δείξει μόνο αποτελέσματα που περιέχουν ακριβώς τη λέξη «αυτοκίνητο».

Ένας μεγεθυντικός φακός (που αντιπροσωπεύει την αναζήτηση) εστιάζει σε έναν ψηφιακό χάρτη. Αντί για λέξεις, ο χάρτης δείχνει “νοηματικά” συμπλέγματα. Ο φακός βρίσκει έννοιες που είναι κοντά μεταξύ τους (π.χ. “Αυτοκίνητο”, “Όχημα”, “Μεταφορά”), ακόμα κι αν είναι διαφορετικές λέξεις, επειδή τα διανύσματά τους είναι κοντινά στον ψηφιακό χώρο.

Vector Store: Θα καταλάβει ότι το «όχημα», η «κούρσα» ή το «αμάξι» έχουν παρόμοιο νόημα και θα σας τα επιστρέψει, ακόμα κι αν η λέξη «αυτοκίνητο» δεν υπάρχει πουθενά!

Γιατί είναι απαραίτητα στο AI

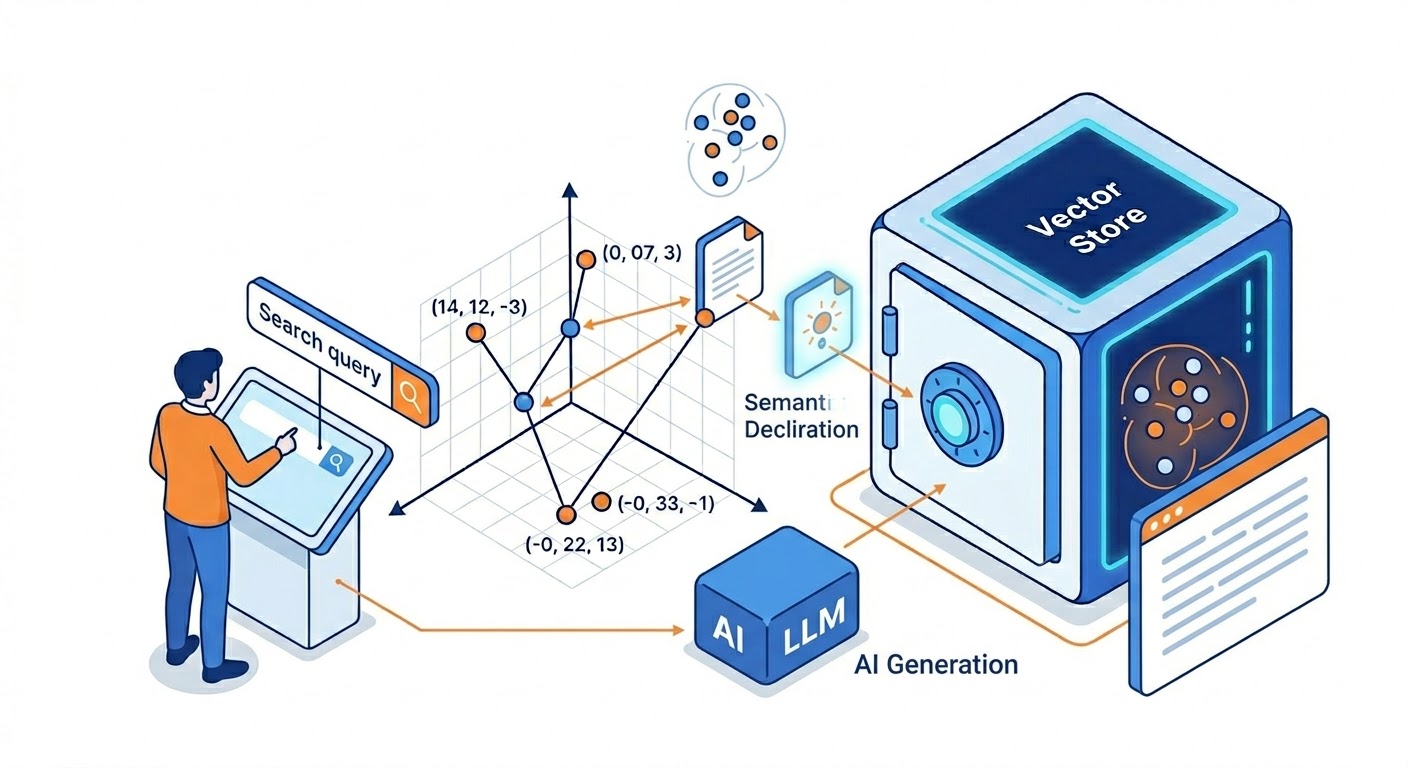

Τα Vector Stores είναι η καρδιά των συστημάτων RAG (Retrieval-Augmented Generation). Επιτρέπουν σε ένα μοντέλο (π.χ. GPT-4) να:

Ανακτά σχετικά έγγραφα από τη βάση δεδομένων σας.

Βλέπουμε μια ολοκληρωμένη ροή. Ένας χρήστης κάνει μια ερώτηση. Η ερώτηση πηγαίνει στο Vector Store (τον “Ψηφιακό Κύβο” που είδαμε στην Image 1). Το Vector Store επιστρέφει σχετικά έγγραφα. Αυτά τα έγγραφα, μαζί με την αρχική ερώτηση, τροφοδοτούνται στο Γλωσσικό Μοντέλο (LLM), το οποίο τελικά παράγει μια τελική, ακριβή απάντηση.

Διαβάζει αυτά τα έγγραφα «on the fly».

Απαντά με βάση τις δικές σας πληροφορίες, μειώνοντας τις πιθανότητες «ψευδαισθήσεων» (hallucinations).

Τα βασικά βήματα της διαδικασίας

Η χρήση ενός Vector Store ακολουθεί συνήθως αυτή τη ροή:

Chunking: Σπάμε τα μεγάλα κείμενα σε μικρότερα κομμάτια.

Embedding: Μετατρέπουμε κάθε κομμάτι σε διάνυσμα (Vector).

Indexing: Αποθηκεύουμε τα διανύσματα στη βάση δεδομένων.

Querying: Όταν ο χρήστης κάνει μια ερώτηση, μετατρέπεται και αυτή σε διάνυσμα και το σύστημα βρίσκει τα «κοντινότερα» διανύσματα στη βάση.

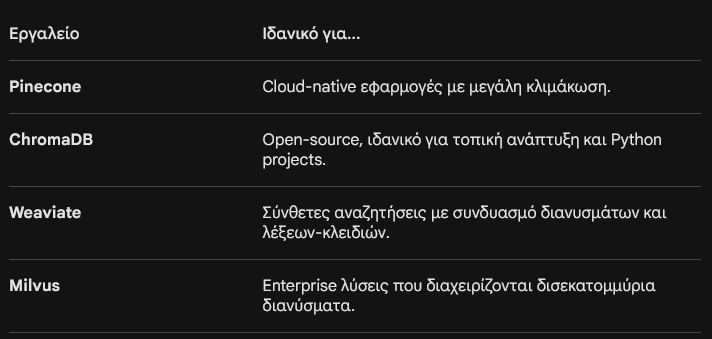

Δημοφιλή Εργαλεία Vector Stores

Αν σκοπεύετε να χτίσετε μια εφαρμογή AI, υπάρχουν αρκετές επιλογές:

Συμπέρασμα

Τα Vector Stores δεν είναι απλά μια αποθήκη δεδομένων· είναι ο τρόπος με τον οποίο γεφυρώνουμε το χάσμα ανάμεσα στην στατική γνώση ενός μοντέλου AI και στα δυναμικά, ιδιωτικά δεδομένα μιας επιχείρησης. Χωρίς αυτά, το AI θα παρέμενε ένας ευφυής συνομιλητής χωρίς πρόσβαση στην πραγματική πληροφορία.